Q&A로 풀어본 핵심 쟁점

소프트웨어가 하드웨어 수요 잠식

‘훈련’ 필요 없어 이르면 연내 가능

비용 줄어 ‘온디바이스 AI’ 앞당겨

판매 대수 늘면 반도체 수요도 증가

‘지능형 메모리’ 미래 기술 선점해야

이미지 확대

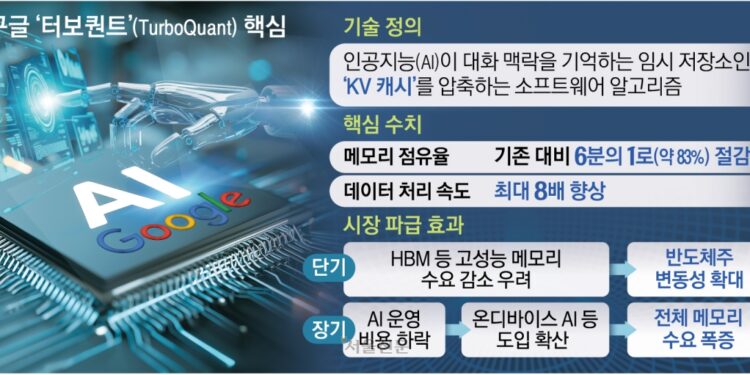

구글 리서치가 인공지능(AI) 모델의 메모리 사용량을 6분의1로 줄이는 혁신 알고리즘 ‘터보퀀트’(TurboQuant)를 전격 공개해 글로벌 반도체 시장에 파장이 일고 있다. 소프트웨어가 하드웨어 수요를 잠식할 것이라는 ‘수요 절벽’ 위기론과 시장 파이가 커질 것이라는 낙관론이 팽팽하다. 29일 핵심 쟁점을 일문일답으로 풀었다.

Q. 터보퀀트란 어떤 기술인가.

A. AI가 대화 맥락을 기억하는 ‘실시간 메모장’(KV 캐시)의 용량을 획기적으로 줄이는 기술이다. 기존에 데이터를 무거운 ‘고화질 사진’로 저장했다면, 화질 손상은 거의 없으면서 용량만 6분의 1로 줄인 ‘고효율 압축 이미지’로 변환하는 식이다. 여기에 보정 필터를 더해 미세 정보까지 선명하게 되살린다. 예컨대 백과사전 6권을 핵심만 요약한 1권으로 만들면서도 답변 정확도는 그대로 유지하는 셈이다.

Q. 과거 구글의 ‘텐서 처리 장치’(TPU)가 공개됐을 때보다 시장이 더 민감한 이유는.

A. TPU가 엔비디아 그래픽처리장치(GPU)라는 하드웨어 장비를 ‘구글 칩’으로 바꿔보겠다는 하드웨어 간의 대체 경쟁이었다면, 터보퀀트는 어떤 연산 장치를 써도 메모리 ‘구매량’ 자체를 6분의 1로 줄일 수 있는 범용 소프트웨어 솔루션이다. 메모리 업체 입장에서 고객사가 칩 브랜드(하드웨어)를 바꾸는 게 아니라, 주문서의 수량(메모리 용량) 자체를 지워버리는 셈이라 타격의 결이 다르다.

Q. 그럼에도 ‘장기 낙관론’이 나오는 이유는.

A. 자원의 이용 효율이 높아져 비용이 낮아지면 전체 소비량이 늘어나는 ‘제본스의 역설’ 때문이다. AI 운영비가 낮아지면 모든 기기에 AI가 기본 탑재되는 ‘온디바이스 AI’ 시대가 앞당겨진다. 개별 기기당 탑재량은 줄어도 판매 대수가 압도적으로 늘어 전체 메모리 수요는 더 커질 것으로 전망된다.

Q. 시장에선 상용화가 이르면 연내 가능할 것으로 보는데.

A. 그렇다. 터보퀀트는 기존 AI 모델을 새로 학습시킬 필요 없이 운영 중인 시스템에 ‘필터’처럼 갈아 끼우는 ‘훈련 불필요’ 방식이다.

Q. 상용화 신중론이 나오는 이유는.

A. 해결할 과제가 많다. 수만 대의 서버가 얽힌 클라우드 시스템에 병목 없이 녹여내는 기술적 최적화가 필수다. 다양한 모델에서 동일한 품질을 내는지 증명해야 하고, 주요 환경에서 별도 튜닝 없이 쓸 수 있는 범용 표준으로 채택돼야 한다. 데이터 복원 과정에서 발생하는 시간 지연과 실시간 대화 품질 저하 우려도 넘어야 한다.

Q. 한국 기업들은 어떻게 대응해야 하나.

A. 삼성전자나 SK하이닉스는 단순히 정해진 규격의 부품만 납품하는 공급자에서 벗어나 AI 시스템 전체의 효율을 설계하는 ‘통합 솔루션 파트너’로서의 역량을 입증해야 한다. 메모리 스스로 연산까지 돕는 지능형 메모리(PIM)나 기기 간 연결 장벽을 허무는 차세대 연결 기술(CXL) 같은 미래 기술을 선점해야 한다.

민나리 기자

2026-03-30 B2면

Copyright ⓒ 서울신문 All rights reserved. 무단 전재-재배포, AI 학습 및 활용 금지

![[단독] 연구는 밭, 적용은 논…‘친환경비료 정책’ 엇박자](https://www.koreandailynews.net/wp-content/uploads/2025/10/SSC_20251017115839_O2-120x86.jpg)